AI do generowania obrazów: Jak zacząć tworzyć grafikę z DALL-E, Midjourney i Stable Diffusion?

2026-04-25AI do generowania obrazów to już nie science fiction, a narzędzie dostępne praktycznie dla każdego. Żeby zacząć tworzyć grafikę z DALL-E, Midjourney czy Stable Diffusion, potrzebujesz przede wszystkim dobrego pomysłu i umiejętności pisania promptów. Reszta to kwestia wyboru platformy i zrozumienia jej specyfiki. Nie ma sensu owijać w bawełnę – każda z tych technologii ma swoje plusy i minusy, a idealnego rozwiązania po prostu nie ma. Zaczynamy od DALL-E, bo jest najprostsze.

DALL-E 3: Wygoda ponad wszystko

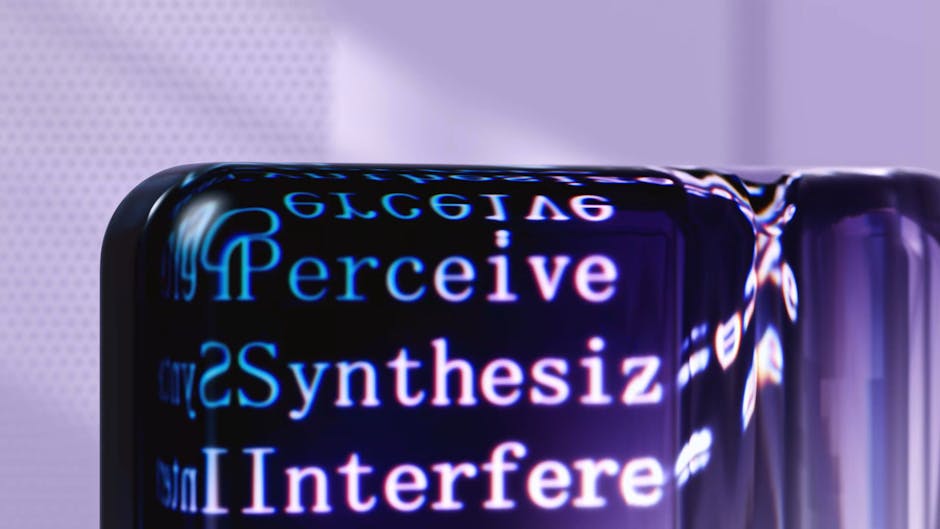

DALL-E 3, dzieło OpenAI, to obecnie jedno z najbardziej przystępnych narzędzi. Nie musisz ściągać nic na komputer. Dostępne jest głównie poprzez ChatGPT Plus (czyli płatną wersję) oraz darmowo, ale z pewnymi ograniczeniami, w Microsoft Copilot. DALL-E 3 jest rewelacyjne, jeśli chodzi o *zrozumienie kontekstu* i generowanie spójnych, logicznych obrazów, nawet z bardzo długich promptów. System świetnie radzi sobie z tekstem na obrazach, co jest bolączką wielu innych generatorów. Serio.

Jak zacząć z DALL-E 3?

- Zaloguj się do ChatGPT Plus lub Copilot. Jeśli masz dostęp do GPT-4, DALL-E 3 jest tam zintegrowane. Po prostu piszesz, co chcesz stworzyć.

- Bądź konkretny, ale daj mu swobodę. DALL-E 3 lubi, jak mu opiszesz nastrój, styl, kolory. Czasem wystarczy proste zdanie, a system sam rozwinie prompt.

- Eksperymentuj z edycją promptu. Jeśli wynik Ci się nie podoba, możesz poprosić ChatGPT, żeby zmodyfikował istniejący prompt i spróbował ponownie. To jest jego siła – konwersacyjny charakter.

- Pamiętaj o ograniczeniach. Czasem wychodzą obrazki jak z katalogu, mocno komercyjne. Jeśli szukasz artyzmu, to nie zawsze DALL-E 3 będzie pierwszym wyborem.

Midjourney: Gdy liczy się artyzm

No dobrze, DALL-E to fajne do szybkich wizualizacji. Ale jeśli szukasz czegoś, co ma *duszę*, to musisz skierować się w stronę Midjourney. To jest narzędzie, które wyznaczyło standardy dla artystycznego renderingu obrazów z tekstu. Działa na Discordzie, co dla wielu jest od razu barierą. Ale jeśli przebrniesz przez interfejs, dostaniesz potężne narzędzie. Widziałem przypadki, gdzie ludzie bez żadnego doświadczenia artystycznego tworzyli cuda, które spokojnie mogłyby wisieć w galeriach. (Nie pytaj skąd wiem, ale widziałem takie cuda). Jest to generator, który ma bardzo specyficzny styl, ale jednocześnie daje dużą kontrolę nad estetyką.

Jak zacząć z Midjourney?

- Konto Discord i subskrypcja Midjourney. Bez tego ani rusz. Darmowy trial kiedyś był, teraz to już przeszłość.

- Dołącz do serwera Midjourney na Discordzie. Tam znajdziesz kanały do generowania obrazów (`#newbies` lub prywatny bot).

- Promptuj z głową. Midjourney uwielbia szczegółowe opisy stylu, oświetlenia, kompozycji. Używaj parametrów, np. `–ar 16:9` dla proporcji, `–v 6` dla wersji silnika (obecnie 6, wcześniej były inne i mocno zmieniały styl).

- Zacznij od prostego promptu. Potem dodawaj detale. `Imagine a futuristic city, cyberpunk style, neon lights, rain, –ar 16:9 –v 6`. Widzisz, konkret.

- Używaj komend `/imagine`, `/blend`, `/shorten`. To są Twoje podstawowe narzędzia. `/shorten` jest super do optymalizacji promptów.

- Iteruj i udoskonalaj. Generuj kilka wariantów, wybieraj najlepszy, upscale’uj, a potem rób „variations” (wariacje) na jego podstawie. To jest klucz do sukcesu.

Stable Diffusion: Pełna kontrola dla zaawansowanych

Stable Diffusion to już inna liga. To narzędzie dla tych, którzy chcą mieć absolutną kontrolę nad każdym pikselem. Możesz je uruchomić lokalnie na swoim komputerze, jeśli masz odpowiednio mocną kartę graficzną. Alternatywnie, są też dostępne platformy online, które oferują jego warianty, np. Civitai, Stability AI’s DreamStudio. Główna zaleta? Nieskończone możliwości modyfikacji. Możesz instalować różne modele, tzw. checkpoints, które są wytrenowane na konkretnych stylach (fotorealizm, anime, malarstwo olejne). Do tego dochodzą rozszerzenia, LORy, ControlNet – masakra ile tam tego jest.

Jak zacząć ze Stable Diffusion?

- Sprawdź swój sprzęt. Do lokalnego Stable Diffusion potrzebna jest karta graficzna NVIDIA z co najmniej 8GB VRAM. Mniej to męczarnia, bez kitu.

- Wybierz platformę. Jeśli nie masz mocnego GPU, zacznij od DreamStudio (oficjalna platforma Stability AI) lub innych serwisów online.

- Jeśli lokalnie: instalacja Automatic1111 Web UI. To jest standard. Jest mnóstwo tutoriali, ale przygotuj się na godziny konfiguracji. (Tak, serio – sprawdzałem, sam z tym walczyłem).

- Modele i checkpoints. Pobieraj je z Civitai lub Hugging Face. To są gotowe zestawy „wiedzy” dla AI.

- Działaj na promptach i negatywnych promptach. Oprócz tego, co chcesz zobaczyć, musisz powiedzieć, czego *nie* chcesz (np. `bad anatomy, blurry, disfigured`).

- Zgłębiaj LORy, ControlNet, inpainting, outpainting. To są zaawansowane techniki, które dają ci kontrolę nad konkretnymi elementami obrazu, kompozycją czy nawet pozami postaci.

Podstawy skutecznych promptów – uniwersalne zasady

Niezależnie od narzędzia, dobre promptowanie to podstawa.

- Bądź precyzyjny. Opisz obiekt, scenerię, styl, nastrój, oświetlenie, kolory, kompozycję.

- Używaj słów kluczowych. Zamiast „ładny obraz”, spróbuj „masterpiece, highly detailed, cinematic lighting”.

- Odwołuj się do artystów i stylów. „In the style of Van Gogh”, „cubist painting”, „cyberpunk aesthetic”.

- Iteruj. Zawsze zaczynaj od prostego pomysłu i stopniowo dodawaj detale, obserwując, jak zmienia się obraz.

- Ucz się od innych. Przeglądaj galerie i sprawdzaj prompty innych użytkowników. To darmowa nauka.

Pamiętaj o etyce i prawie

Korzystając z AI do generowania obrazów, zawsze pamiętaj o kwestiach prawnych i etycznych. Prawa autorskie do obrazów generowanych przez AI to temat rzeka i ciągle się rozwija. Nie wykorzystuj cudzych stylów bezrefleksyjnie ani nie generuj treści, które mogą naruszać czyjeś dobra osobiste czy prawa autorskie. To ważne.

Najczęstsze pytania

Czy potrzebuję drogiej karty graficznej do generowania obrazów AI?

Nie do wszystkich. DALL-E 3 (przez ChatGPT Plus/Copilot) i Midjourney działają w chmurze, więc potrzebujesz jedynie dostępu do internetu. Do Stable Diffusion lokalnie – tak, mocna karta NVIDIA jest niezbędna.

Ile kosztuje generowanie obrazów AI?

Zależy od narzędzia. DALL-E 3 jest w płatnym ChatGPT Plus (ok. 20 USD/miesiąc) lub w darmowym Copilocie z limitami. Midjourney to koszt ok. 10-60 USD/miesiąc w zależności od planu. Stable Diffusion online (np. DreamStudio) działa na systemie kredytów, lokalnie – płacisz za prąd i sprzęt.

Czy AI zastąpi grafików?

Nie, ale zmieni ich pracę. Graficy, którzy opanują narzędzia AI, będą mieli przewagę. AI to potężne narzędzie wspomagające, a nie zamiennik kreatywności i umiejętności ludzkich.

Co zrobisz z tym dalej – twoja sprawa.